Transparente KI-Anwendung sagt Brustkrebsrisiko voraus

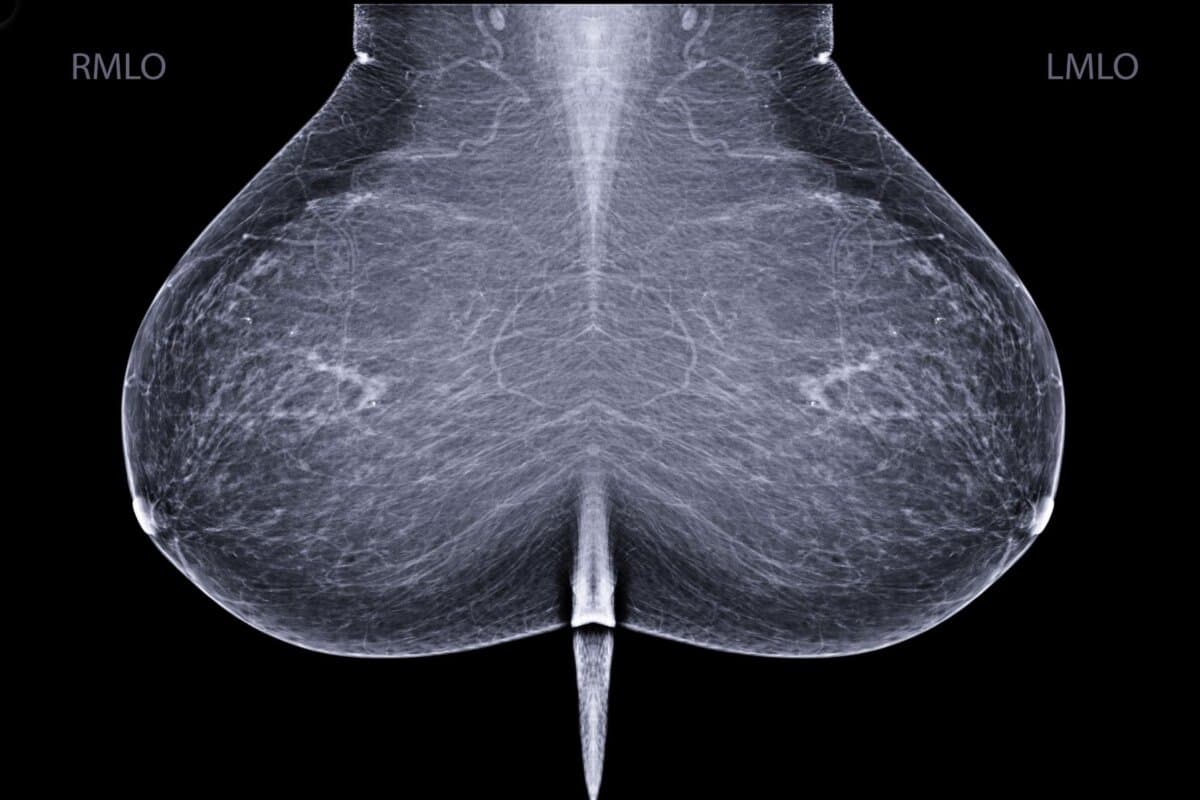

Vor drei Jahren stellten Forscher die künstliche Intelligenz-Anwendung Mirai vor. Sie kann das Brustkrebsrisiko der kommenden fünf Jahre anhand von Mammographien mit hoher Wahrscheinlichkeit vorhersagen. Doch Mirai agiert für Menschen unverständlich – und ist damit für die klinische Anwendung untauglich. Nun wurde AsymMirai entwickelt, eine KI mit ähnlicher Genauigkeit wie Mirai, und einer transparenten Funktionsweise. Das könnte Experten zufolge eine neue Ära einläuten.

«Wir können mit erstaunlich hoher Genauigkeit vorhersagen, ob eine Frau in den nächsten ein bis fünf Jahren an Krebs erkranken wird, und zwar allein auf der Grundlage von lokalen Unterschieden zwischen ihrem linken und rechten Brustgewebe», sagt Jon Donnelly, (1) Autor der Studie im Journal Radiology (2).

Dies gelang den Forschern mit Hilfe des KI-Algorithmus AsymMirai. Dieser arbeitet im Gegensatz zu seinem Vorläufer Mirai für den Menschen nachvollziehbar (transparent). Die KI-Lösung schaffte die Risikovorhersage in der Arbeit besser als konventionelle statistische Risikorechner wie das Tyrer-Cuzick-Modell und frühere AI-Lösungen.

Mammografien erkennen nur den «Status quo»

In der Schweiz erkrankt statistisch gesehen eine von acht Frauen während ihres Lebens an Brustkrebs. Lassen Frauen regelmässig eine Mammographie durchführen, senkt das nachweislich ihr Risiko, an Brustkrebs zu sterben.

Obwohl Mammographien Tumoren früh entdecken können, werden sie aber derzeit noch nicht dazu genutzt, um das individuelle Risiko einer Frau für die Entwicklung von Brustkrebs vorherzusagen. Dafür wendet man stattdessen üblicherweise Risikorechner wie das Tyrer-Cuzick-Modell an. Diese nutzen aber lediglich die persönliche und familiäre Vorgeschichte zur statistischen Risikoberechnung, und sind daher einigermassen ungenau sind. Man hofft daher, dass die künstliche Intelligenz helfen wird, das volle Potenzial der Mammographie auch in Bezug auf die Berechnung des Krebsrisikos auszuschöpfen.

«KI-Interpretierbarkeit Voraussetzung für die klinische Anwendung»

Genau dafür wurden Algorithmen wie Mirai entwickelt, ein grosses und komplexes neuronales Netzwerk, das ähnlich wie ChatGPT das auf Deep Learning basiert. Da bislang jedoch wenig über seinen Denkprozess bekannt ist, schätzten Experten Mirai als nicht für die klinische Anwendung geeignet ein.

«Die Interpretierbarkeit künstlicher Intelligenzen ist eine ethische Voraussetzung für ihre Anwendbarkeit in der Radiologie» schreibt etwa die kanadische Radiologin Professor Dr. Vivianne Freitas, Joint Department of Medical Imaging, Toronto, in einem begleitenden Editorial zur Studie (3). «Dadurch, dass die Programme selbstlernend sind, könnten sogar Entwickler Schwierigkeiten haben, den genauen Weg zu einem bestimmten Ergebnis nachzuvollziehen.»

Schliesslich könnten sich unerfahrene Radiologen zu sehr auf die künstliche Intelligenz verlassen, und anhand ihrer Aussagen ungenaue Diagnosen stellen.

Von «Blackbox»-Daten zu transparenter Funktionsweise

«Mirai ist eine Blackbox» räumt auch der amerikanische PhD-Student Jon Donnelly, Duke University in Durham, North Carolina, ein, der das Programm nun weiterentwickelt hat. «Niemand wusste, wie es seine Entscheidungen traf.»

Das Forscherteam versuchte, herauszufinden, wie Mirai genau funktionierte. Dazu suchte es nach Bildmustern, die Mirai erkennen und für das errechnete Brustkrebsrisiko heranziehen könnte. Auf Basis dieser Merkmale bauten sie den Algorithmus AsymMirai auf dem Mirai-System auf, der nach menschlich nachvollziehbaren Kriterien arbeitet.

AsymMirai orientiert sich nun an Gewebsunterschieden zwischen der linken und der rechten Brust, der «lokalen bilateralen Unähnlichkeit», die auchMirai verwendete, um Tumoren zu erkennen.

Die Forscher testeten den neuen Algorithmus an 210.067 Mammogrammen aus den Routine-Screenings von 81.824 Patientinnen, die in der EMory BrEast imaging Datenbank (EMBED) vorlagen. Dabei handelt es sich um einen öffentlich verfügbarem Datensatz, der Bild- und Patientendaten von Frauen unterschiedlicher Ethnien aus den USA, Schweden und Taiwan enthält.

5-Jahres-Vorhersagegenauigkeit von 66 %

AsymMirai spiegelte dabei die Voraussagen von Mirai wieder, und erzielte eine vergleichbare Leistung. So war AsymMirai in der Lage, das Fünfjahres-Brustkrebsrisiko von 66 Prozent der Frauen in der EMBED-Datenbank korrekt festzustellen (Mirai: 71%). Bei einer Subgruppe von 183 Patientinnen, von denen AsymMirai wiederholte Scans des selben Brustgewebes vorgelegt wurden, erreichte es sogar eine 3-Jahres-Vorhersagegenauigkeit von 92 Prozent.

Die Annäherungswerte von Mirai und AsymMirai sind damit höher als mit dem Tyrer-Cuzick-Modell und früher veröffentlichten Deep-Learning Modellen (z.B. Hybrid DL, Image-Only-DL).

Die Autoren hoffen, dass das neue System in Zukunft Radiologen unterstützen könnte, und die Festlegung der Häufigkeit von Mammographien beeinflussen könnte.

Transparente Lösungen unterstützen KI-Akzeptanz

Dabei, dass Ärzte etwa bei der Festlegung des Zeitraumes zwischen den Mammographien der künstlichen Intelligenz vertrauen, können transparente Lösungen wie AsymMirai helfen, so Dr. Freitas in ihrem Leitartikel: «Die Ergebnisse machen die KI greifbarer und verständlicher – das verbessert ihre Akzeptanz.» Für sie schlägt der Algorithmus daher ein neues Kapitel im Bereich der KI auf.

-

Donnelly J et al. AsymMirai: Interpretable Mammography-based Deep Learning Model for 1-5-year Breast Cancer Risk Prediction. Radiology. 2024 Mar;310(3):e232780. doi: 10.1148/radiol.232780.

- Radiological Society of North America (RSNA). Researchers Develop Deep Learning Model to Predict Breast Cancer. 19. März 2024, abgerufen am 21. März 2024

- Freitas V. Launching a New Era of Artificial Intelligence in Health Care. Radiology. 2024 Mar;310(3):e240474. doi: 10.1148/radiol.240474.